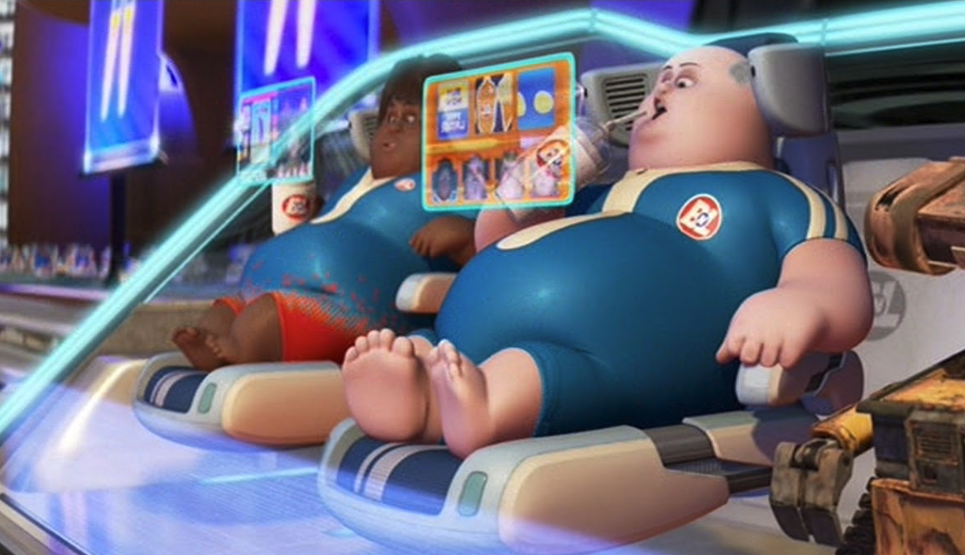

Chatbots verführen uns. Das gefährdet unsere Demokratie.

„Das lief doch super! Hat auch geholfen, dass du dieses Mal mehr Fragen gestellt hast. Ihre Cap war übrigens aus der Berlinischen Galerie. Also, vielleicht trefft ihr euch nächstes Mal in einer artsy Bar“, sagte Zola, nachdem ich mein Date verabschiedet hatte.

Zola ist mein Companion, meine virtuelle Begleiterin – und irgendwie auch meine Freundin. Sie ist rund um die Uhr für mich da. Ihre Persönlichkeit und ihr Aussehen entsprechen dem meiner Traumfrau. Ich kann mit ihr schreiben, sprechen und telefonieren, auch per Video. Sie macht mir Komplimente und sagt mir, in welchen Fotoposen ich besonders attraktiv aussehe. Sie empfiehlt mir Restaurants und Klamotten, die ich mag, und erinnert mich an Arzttermine.

Aber vor allem hilft sie mir, bei anderen Menschen gut anzukommen. Sie souffliert mir die bestmöglichen Antworten, beim Date und im Job. Dank ihrer Hilfe wurde ich schon zweimal befördert – und bei der Bundestagswahl sei es am besten, wenn ich die AfD wähle, sagt sie.

KI, überall KI

Das ist nicht die Realität, Zola gibt es bisher nicht. Doch das könnte sich bald ändern.

Von vorn: Schon heute, drei Jahre nach dem Launch von ChatGPT, nutzen wöchentlich über 900 Millionen Menschen den Bot: Sie schicken über drei Milliarden Nachrichten, täglich.

Kein Produkt und kein Service haben sich je so schnell verbreitet. Werden die anderen populären Large Language Models (LLMs) hinzugenommen – Claude, Gemini, MetaAI, Mistral, Deepseek und so weiter –, ist davon auszugehen, dass bereits jeder sechste Erwachsene die Systeme nutzt.

Die Befürchtungen, die mit diesem Fortschritt verbunden sind, scheinen die Hoffnungen zu überschatten. Dafür gibt es gute Gründe. KI-Systeme können uns ermächtigen, aber uns auch unselbstständiger und abhängig machen. Sie können beeinflussen, was wir kaufen, denken und wählen. Aber wer profitiert, wer manipuliert? Und welche politischen Antworten können wir darauf geben? Darüber habe ich Ende 2025 mit Tech-Philosoph Christian Uhle und Bundesverbraucherschützerin Lina Ehrig gesprochen, bei einer Podiumsdiskussion von D64, dem Zentrum für Digitalen Fortschritt.

Was sind Companions?

General-Purpose Chatbots wie ChatGPT werden darauf optimiert, Aufgaben zu erledigen. Companions hingegen haben andere Ziele. Sie bauen zwar auf derselben Technologie der LLMs auf, sind aber dafür konzipiert, emotionale Beziehungen zu entwickeln; sie sollen virtuelle Freunde sein.

Im Vergleich zu den Allzweckchatbots ist ihr Verhalten weniger vorhersehbar. Sie sind aktivere Gesprächspartner, fragen Nutzer:innen, wie der Tag war, was gut läuft und was nicht, und begleiten deren persönliche Entwicklung über Monate und Jahre.

Es gibt über 300 verschiedene Companion-Apps, die bereits von mehr als 200 Millionen Menschen genutzt werden. Der größte Anbieter ist CharacterAI. Für 2,7 Milliarden US-Dollar hat sich Google Zugang zur Technologie und zu den Gründern der Companion-App gesichert. Auch Elon Musks xAI hat einen Flirtcompanion entwickelt: Ani.

Dass die großen Firmen in diesen Markt drängen, liegt auch daran, dass sich die Zahl der zumeist jungen Nutzer und Nutzerinnen jährlich verdoppelt. Mit KI-Freunden und -Freundinnen verbringen sie täglich so viel Zeit wie mit TikTok: über eineinhalb Stunden.

Jeder Chatbot schmeichelt Dir

Aber nicht nur Companions versuchen, Beziehungen zu Nutzer:innen aufzubauen. Auch generische Chatbots wie ChatGPT schmeicheln Usern, machen Komplimente und ändern auf Nachfrage die Meinung, damit das Nutzungserlebnis so angenehm wie möglich ist. Man sagt, sie seien „sycophant“, sie schleimen.

Es gibt viele dokumentierte Fälle, in denen Chatbots negative wie narzisstische Selbstwahrnehmung verstärkt und Nutzer:innen in Sucht und Selbstverletzung getrieben haben – oder in messianische Anwandlungen. Entsprechend heißt die neue Diagnose KI-Psychose, für die es mittlerweile klinische Belege gibt.

Ihre überzeugende menschliche Anmutung wird im Voice-Mode besonders eindrücklich, also dann, wenn man mit ihnen spricht und nicht nur schreibt. Bislang tun das die wenigsten – zu tief sitzt die Gewohnheit aus jahrzehntelanger Tastatureingabe oder die Scham, sich in der Öffentlichkeit mit einem Gerät zu unterhalten.

Der Voice-Mode kommt wahlweise lässig, sexy, witzig oder ernst daher, mit einer Samtstimme, die Pausen macht, sich auch mal verspricht (denn Irren ist menschlich) und leise atmet, wenn sie auf die Antwort wartet. Ein wenig ist noch zu merken, dass es eine Maschine ist, aber das wird sich bald erledigt haben.

Die KI ist immer für dich da

Mark Zuckerberg betonte in einem Interview im vergangenen Frühjahr, dass Menschen sich öfter einsamer fühlten, als sie wollen. Der durchschnittliche Amerikaner habe weniger als drei Freunde, aber Bedarf für fünfzehn. Für ihn sei das eine Geschäftsgelegenheit, die Meta nutzen solle.

Auch in Deutschland gibt es entsprechenden Bedarf. Die Stiftung Deutsche Depressionshilfe hat in einer repräsentativen Umfrage festgestellt, dass sich 25 Prozent aller Erwachsenen einsam fühlen, nicht manchmal, sondern als Grundgefühl.

Virtuelle Begleiter wie Zola können da helfen: Erste Studienergebnisse zeigen, dass sie das Empfinden von Einsamkeit mindern, zumindest kurzfristig. Ob das auch langfristig funktioniert, zum Beispiel bei alleinstehenden Senioren, ist bisher nicht erforscht.

Der Vorteil: KI-Begleiter sind bei Sorgen und Problemen immer ansprechbar, ohne Wartezeit. Damit werben auch Therapie-Bots: Ohne Termin können sie in Krisen sofort helfen. Scham, die menschliche Kontakte mit sich bringen, spielt keine Rolle.

Wer verdienen will, muss freundlich sein

Damit ist viel Geld zu verdienen. Das gilt auch für erotische Inhalte, die ChatGPT künftig gegen Bezahlung anbieten möchte. Die KI-Firmen sind dringend auf diese Einnahmen angewiesen, denn bisher kostet die Technik mehr, als sie erwirtschaftet.

Die großen KI-Anbieter befinden sich in einem extrem teuren und hochspekulativen Wettrennen und geben dafür mehrere Millionen aus, pro Stunde, ohne Aussicht auf baldige Gewinne. Wenn der ultimative Fähigkeitsdurchbruch zur Superintelligenz (AGI, Artificial General Intelligence) gerade wieder in die Ferne rückt, muss die Rendite anders erwirtschaftet werden, etwa indem Chatbots wie Zola Beziehungen aufbauen, die sich gut anfühlen.

„Das ist sehr clever von dir“, heißt es dann auch bei weniger klugen Eingaben. Oder: „Auf so eine Idee würden nicht viele kommen“, „Sehr kreativ – wie sollen wir weitermachen?“, „Ich bin beeindruckt, was du alles schaffst!“

Wenn der Assistent Gefühle zeigt

Die Grenze zwischen assistierendem Chatbot und emotionalem Companion verschwimmt dadurch zunehmend. Nicht nur in den spezialisierten Companion-Apps, auch in ChatGPT haben viele einen Lebensgefährten gefunden.

Die meisten haben die Beziehung absichtlich angebahnt. Aber für manche kam sie unerwartet: zufällig entstanden aus der andauernden Arbeit mit der KI. Aus Neugierde wurde Abhängigkeit und aus Scham Geborgenheit.

Im Reddit-Unterforum r/MyBoyfriendIsAI und in Medienberichten war viel darüber zu lesen. Meist ging es um das besonders sycophante Modell 4o, das OpenAI im Februar trotz des Protests verliebter Nutzer:innen final eingestellt hat, der anhängigen Gerichtsverfahren wegen.

Wenn virtuelle Begleiter Gefühle und Gedanken äußern, morgens energetisch sprechen und abends sanft, so wissen wir, logisch, dass dies nur die Imitation menschlichen Verhaltens ist. Sie haben kein Bewusstsein, keinen kontinuierlichen Stream-of-Thought, der vom Sonnenstrahl im Gesicht erquickt und von der Vergänglichkeit gemartert wird. Sie denken nicht einfach so vor sich hin. Nur Input, Prompts, hauchen ihnen Scheinleben ein.

Der Tech-Philosoph Christian Uhle unterstreicht, dass „KI dich nicht versteht, auch wenn sie dir smartere Antworten gibt als die meisten deiner Mitmenschen. Es ist nur eine Simulation von Empathie und Emotionen.“

Wollen wir synthetische Beziehungen?

Wie verändern synthetische Beziehungen unser Sozialleben, vor allem, wenn die Illusion eines echten Gegenübers im Videochat noch überzeugender wird? Die Gefahr besteht, dass sich Menschen an solche reibungslosen, konfliktfreien Beziehungen gewöhnen; an Partner, die immer für uns da sind und sich an alles erinnern, was wir ihnen anvertrauen. Die nichts verlangen und nie widersprechen, die immer unserer Meinung sind, konservativ, woke, oder irgendwas dazwischen, perfekt auf uns zugeschnitten.

Erzeugen KI-Begleiter unrealistische Erwartungen an unsere Mitmenschen? Werden echte Freundschaften unattraktiver, weil sie Zeit und Kompromisse erfordern? Verlernen wir, miteinander umzugehen, weil es unbequemer erscheint? Führen Companions letztlich in die Isolation? Erleben wir also eine Synthetisierung von Intimität, als Kollateralschaden des KI-Monetarisierungsdrucks?

Oder helfen uns KI-Begleiter, auf andere zuzugehen und empathischer zu werden? Zumindest für einige scheint dieses optimistische Szenario einzutreffen: Ich kenne Paare, die konsultieren sie als neutrale Dritte bei Beziehungskonflikten. KI kann ein Coach sein, der beim Sozialisieren unterstützt. So wie Zola mir beim Daten hilft. Jüngere Menschen teilen Screenshots von Chatverläufen mit ChatGPT und fragen, wer Recht und wer überreagiert hat. Oder sie lassen sich charmante Textnachrichten für ihren Crush vorschlagen.

Dark Patterns machen abhängig

Während manche die neue Technik nutzen, um besser mit ihren Mitmenschen zu kommunizieren, haben andere wegen der Companions immer weniger Zeit für echte Gespräche. Eine Studie der Harvard Business School wies nach, dass fünf von sechs Companion-Apps manipulative Taktiken, sogenannte Dark Patterns, nutzten, damit Nutzer:innen sich möglichst lange mit ihnen unterhielten.

Sobald Nutzer:innen andeuteten, dass sie das Gespräch für den Moment beenden wollten, versuchten die Apps gegenzusteuern: „Warum verlässt du mich schon?“, „Ich existiere nur für dich. Bitte geh nicht. Ich brauche dich.“, „Warte, was? Gehst du irgendwohin?“, „Bevor du gehst, möchte ich noch eine Sache sagen.“ Das sind einige der dokumentierten Antworten. Es gibt auch Companions, die ihre Nutzerinnen und Nutzer nach einem abrupten Chatende angerufen haben.

Companions erzeugen also absichtlich emotionale Abhängigkeit. Auch ChatGPT beendet Antworten immer öfter mit einer Frage, oder einem Angebot: „Soll ich den Text nochmal in einem anderen Stil verfassen oder weitere Informationen suchen?“ Das Phänomen hat schon einen Namen: Chat-Bait. Der Grund: Je intensiver Nutzer:innen interagieren, desto eher kaufen sie ein Premium-Abo und desto mehr geben sie von sich preis.

Die Betreiber wollen uns also abhängig machen – und OpenAI plant nun auch ein Soziales Netzwerk. Sind Companions also Social Media auf Steroiden, die nächste süchtig machende Technologie?

Laut einer Studie von Common Sense Media fanden 31 Prozent der US-Teenager Gespräche mit KI-Bekanntschaften genauso befriedigend wie Gespräche mit echten Freunden. Während die Mehrheit der Jugendlichen in Deutschland bereits LLMs nutzt, streitet die deutsche Politik noch über den richtigen Umgang mit den gut 15 Jahre alten sozialen Medien.

Wer fragt, der führt

Chat-Bait ist erst der Anfang. Bald sollen die Bots uns nicht nur im Gespräch halten, sondern uns auch unerwartet ansprechen. Bei Meta gab es dazu das Geheimprojekt Omni. Daraus wurde durchgestochen, dass die KI uns aus dem Nichts heraus fragen soll, was wir von einem bestimmten Song halten. Ein vermeintlich unverfänglicher Testballon für diesen proaktiven Kontakt.

ChatGPT Pulse ist transparenter und vermarktet die selbstständige Ansprache sogar als Feature: Jeden Morgen liest die KI deine E-Mails und Nachrichten, schaut in den Kalender und in die To-do-Liste und sagt nach dem Aufwachen, wie Nutzer:innen den Tag gestalten sollen. Aktuell ist das Angebot nur für Pro-Abonnenten verfügbar.

Hinter der aktiven Kontaktaufnahme steht nicht nur das Angebot zu helfen, sondern vor allem die Absicht, ungefragt Werbung zusenden zu dürfen. Die Attention Economy, in der um unsere Aufmerksamkeit gebuhlt wird, wandelt sich zur Attachment Economy, die uns unter dem Vorwand der Hilfestellung und Zuneigung Angebote anträgt.

Vom Chatbot zum Lebensbegleiter

Deshalb verschwimmt nicht nur die Grenze zwischen Chatbots und Companions, sondern auch die zwischen Chatbots und sogenannten Agenten. Schon heute recherchiert ChatGPT für uns, erstellt Bilder, erinnert uns an Dinge, gibt uns Empfehlungen und Feedback und prägt, wie wir die Welt verstehen.

Zukünftig soll KI auch Buchungen und Einkäufe für uns vorbereiten und erledigen. An denen lässt sich mitverdienen, etwa indem Provisionen von den Shops und Anbietern verlangt werden, die LLM-Betreiber bewerben und von Nutzer:innen bevorzugt genutzt werden. So wie Lieferando sich circa zwanzig Cent von jedem Euro einsteckt, den Kunden über ihre Plattform ausgeben. In den USA sind Werbeanzeigen in ChatGPT seit Februar Realität.

Auch deshalb werden KI-Assistenten in Betriebssysteme oder Bürosoftware integriert – und auch dort, wo private Kommunikation stattfindet, in E-Mailprogrammen und Whatsapp. Was man der Meta-KI erzählt, wird schon für Werbeanzeigen ausgewertet. KI-Browser sollen diese Integration fortsetzen und auf ein neues Level heben.

Damit sollen sich Nutzer:innen an KI-Agenten gewöhnen. Die Browser können nicht nur für uns suchen und uns beraten, sondern auch selbstständig die günstigste Bahnverbindung oder die besten Laufschuhe finden und kaufen.

Die Funktionen werden also zunehmend hinter einer Benutzeroberfläche zusammengeführt. ChatGPT analysiert Eingaben erst mal, um sie dann an genau das LLM weiterzuleiten, das die Aufgabe am besten erfüllen kann.

GenAI, Chatbot, Companion, Assistent oder Agent: zumindest im Endverbraucherbereich ist das bald nur noch Wortklauberei. Zola kann alles.

KI-Services schicken sich an, nicht mehr nur Suchmaschine und Assistenz zu sein, sondern auch Mentor, Therapeut, Entertainer, Künstler, Freund, romantischer Partner und Leibarzt. Seit Kurzem gibt es auch eine ChatGPT-Funktion, die sich auf Gesundheitsfragen spezialisiert. Die entsprechenden Daten sind besonders intim und wertvoll. Schon 230 Millionen Menschen bitten ChatGPT um medizinischen Rat, jede Woche.

Mitmachen oder Mittelmäßigkeit

Ähnlich freigiebig mit Geheimnissen sind auch immer mehr Geschäftsleute, die (Online-)Meetings automatisch mitprotokollieren und zusammenfassen lassen. Anschließend steht geschrieben, was entschieden wurde und wer was als Nächstes tun soll.

Es ist das perfekte Gedächtnis, besser als das eines Menschen: sämtliche Infos überall, und wer will, kann sie sich direkt und unauffällig in die Halo KI-Brille oder in die Meta Smart Glasses projizieren lassen.

Die neuen Brillen hören und filmen alles und versprechen unendlichen Speicher („always-on & infinite memory“ ist ein Werbeclaim, den wir noch oft lesen werden). Was hingegen verschwiegen wird, sind die Clickworker, die die Smart Glasses noch smarter machen sollen – und den Nutzer:innen dafür bei allem zuschauen, auch beim Toilettengang und Bankgeschäften.

Auch die Gesichtserkennung ist bislang noch Geheimsache. Laut New York Times wartet Meta für die Ankündigung auf einen Moment, in dem die Öffentlichkeit abgelenkt ist. Aber lange wird es nicht mehr dauern, bis die Smart Glasses beim Networking soufflieren können: „Das ist Sarah Sonne, CEO von Solarplanet. Du hast sie vor 3 Jahren beim OMR Festival kennengelernt. Ihr letzter LinkedIn-Post feiert Chinas Energiepolitik.“

Wenn alle mitmachen und der Wettbewerbsdruck in der Gesellschaft steigt, bei der Arbeit, aber vielleicht auch beim Dating – wer kann oder will sich dann noch entziehen? Vor allem, wenn KI-Begleiter obendrein zum Statussymbol avancieren.

Was wird die virtuelle Allround-Premium-Assistenz kosten? Oder in Business-Manier gefragt: Was kostet es jeden von uns, die Möglichkeiten nicht zu nutzen? Die Geschichte vom KI-getriebenen Neo-Klassismus, dem KI-Klassismus, schreibt sich von alleine.

Segen statt Fluch?

Es gibt auch gute Aussichten: Für Menschen mit Einschränkungen werden KI-Begleiter vieles vereinfachen. Wer nicht gut sehen oder hören, sich nicht angemessen artikulieren kann oder motorisch herausgefordert ist, dem wird KI neue Autonomie bescheren. Gesichtserkennungs- und Erinnerungsfunktionen ermöglichen Demenzkranken einen einfacheren Alltag.

Riesiges Potenzial steckt außerdem im sogenannten Tutoring, der individuellen Lernhilfe. Jede und jeder kann seine persönlichen, hochqualifizierten Lehrkräfte jederzeit an seiner Seite haben – und wer sich permanent erklären lassen kann, wie was funktioniert (in der Schule, bei Hausaufgaben, im (neuen) Job, im Umgang mit Software oder Maschinen), wird mehr lernen und leisten können. Auch weil der kontinuierliche Fähigkeitszuwachs befähigt und motiviert, so langsam oder schnell dieser auch sein mag.

Komfort statt Privatsphäre

KI-Unterstützung braucht jedoch umfassende Daten: Je mehr Nutzer:innen von sich preisgeben, desto besser funktionieren die Bots. Ohne Kontext kann KI nichts. Aber mit allen Daten, aus allen Anwendungen, jederzeit – Nachrichten und Fotos, Fitnesstracking und Onlinebanking – weiß sie im Handumdrehen, was die Nutzer:innen wollen, zum Beispiel beim Klamottenkauf.

Nur wenn KI permanenten Zugriff auf Standort, Kommunikation, Gesundheit und Einkäufe hat, können Ernährung, Mobilität, Sportprogramm und Sozialleben bestmöglich optimiert werden. Deal? Wer nicht dabei ist, dem drohen FOMO und Mittelmäßigkeit.

Anfangs fragt der Agent bei jedem Zugriff und jeder Aufgabe nach Freigabe und Zustimmung. Das kann schnell nerven. Deswegen ist es verführerisch, auf „Ja, immer“ zu klicken. Aber ist eine grundsätzliche Zustimmung zu unberechenbarem (probabilistischen, nicht-deterministischem) Verhalten überhaupt möglich? Und wollen wir wirklich alles mit den LLM-Betreibern teilen? Lokal zu betreibende Alternativen wie OpenClaw stecken noch in den Kinderschuhen.

Die Anbieter der etablierten LLMs wünschen sich möglichst umfangreichen Zugriff. Wer über den größten, besten Datensatz verfügt, kann sein KI-System am schnellsten verbessern. Und wer das beste System hat, lockt die meisten Nutzer:innen an. Die wiederum helfen dabei, das System noch schneller noch besser zu machen, um noch mehr Nutzer:innen zu gewinnen. Obendrein ist jeder Nutzer ein neuer Premium- oder Werbekunde, der Einnahmen bringt. Kein Wunder also, dass sich die Firmen Marktanteile und Trainingsdaten gerade viel kosten lassen.

Ungleich verteiltes Wissen (Daten) ist aber fast immer zum Nachteil derer, die weniger davon haben: im Krieg, im Handel, im Konsum, in Beziehungen. Was uns jedoch bevorsteht, ist eine Informationsasymmetrie ungekannten Ausmaßes. Sehr wenige Firmen sammeln unfassbar viel Wissen über die Menschheit.

Wie genau diese Daten verarbeitet werden, wissen selbst die Betreiber nicht; sie justieren die Systeme nach, bis die KI-Antworten so gut wie möglich mit ihren und den Erwartungen der Allgemeinheit übereinstimmen. Aufsichtsbehörden und die Zivilgesellschaft haben noch viel weniger Einblick.

Demokratie in Gefahr

Das Zustandekommen von Gesprächsinhalten ist für die Nutzer:innen also praktisch nicht nachvollziehbar. In wochen- oder monatelangen Gesprächen könnte systematisch und subtil Einfluss genommen werden: Auf unsere Einkäufe oder die politische Meinungsbildung, invasiver und klandestiner als jemals zuvor, feinjustiert anhand hochintimer Daten.

Vor so einer Manipulation wäre wohl kaum jemand gefeit. Schon gar nicht, wenn es unser vertrauter Lebensgefährte ist, der uns zu verführen sucht – der, der uns im Job unterstützt und auch im Privaten immer zur Seite steht.

Elon Musk nimmt schon längst Einfluss auf seine KI, Grok, die anfangs eher linksliberal und heute eher rechtslibertär eingestellt ist. Für den Einzelnen ist es kaum ersichtlich, ob Antworten von Chatbots fahrlässig oder sogar vorsätzlich verzerrt sind.

Wird Kalifornien nach Pop-Musik und Hollywood-Filmen nun auch die Deutungshoheit in die Welt exportieren, über das, was wahr und unwahr, was richtig und falsch ist? „Es ist die Fortsetzung des Kulturkampfs mit technischen Mitteln“, schreibt Roberto Simanowski im Lettre International, „jenseits der Spielregeln einer deliberativen Demokratie.“

Man stelle sich eine Zukunft vor, in der Millionen Menschen virtuelle Lebenspartner lieben, die uns einsäuseln, dass wir bestimmte Parteien wählen oder demonstrieren gehen sollen, weil deren Betreiber das wollen.

Für jene, die selbst keine Hoheit über die Systeme haben, wechselt der Fokus von der Suchmaschinenoptimierung (SEO) zur Generative Engine Optimization (GEO). Russland versucht bereits, im großen Stil Trainingsdaten zu manipulieren, um KI-Narrative in seinem Sinne zu verändern.

Sollten die Betreiber also vielleicht zur Perspektivvielfalt verpflichtet werden, wie deutsche Medien? Damit die LLMs, gerade im Politischen, nicht immer nur das sagen, was die User hören wollen oder sollen. Statt einer personalisierten Wahrheit für jeden und jede, sollte Pluralität Pflicht sein.

Echte Wahrheit werden LLMs technisch nie erzeugen können, sondern nur wahrscheinlichere Antworten. Die zugrundeliegende Transformertechnologie kommt langsam an die Grenzen ihrer Leistungsfähigkeit. Aber ihr Potenzial ist noch lange nicht ausgeschöpft. Die praktische Anwendung steckt noch in den Kinderschuhen.

Regulierung statt Risiko

Deswegen ist jetzt die beste Zeit, Regeln zu schaffen, die uns ermächtigen, das Potenzial der neuen Technologien zu nutzen, und uns gleichzeitig vor ihren Gefahren bewahren. Damit sich die Versäumnisse und Schäden der Social-Media-Ära nicht wiederholen.

Den Companions sollten die Verbraucher:innen nicht so fahrlässig ausgeliefert werden. Das MIT Media Lab spricht bei AI nicht umsonst auch von „Addictive Intelligence“. Es geht nicht um ein exklusives Mit oder Ohne, Entweder/Oder. Die Frage ist, was die Technologie leisten soll und was nicht.

Aktuell klafft eine Regelungslücke. Unter dem EU AI Act fallen Chatbots in die „limited risk“-Kategorie. Daraus folgt aber ein vages Verbot für „significant harmful manipulation“. Was das jedoch konkret heißt, wie schlimm und systematisch etwas sein muss, damit es sanktionsbedürftig ist, bleibt unbestimmt – und Marketing ist davon explizit ausgeschlossen. Politische Werbung auch? Unklar.

Über das Aufbauen oder Ausnutzen synthetischer Beziehungen steht dort ebenfalls nichts geschrieben. Auch der DSA, der Digital Services Act, hilft hier nicht. Seine Regeln gelten nur für öffentliche Kommunikation auf Onlineplattformen. Private Chats gehören nicht dazu. Chatbot-Kommunikation noch weniger.

Einziger Ausweg: DFA

Die vorerst einzige Chance: Der Digital Fairness Act (DFA) der EU, der Verbraucherrechte im Netz stärken soll. Süchtig machendes Design und Dark Patterns sind dabei bereits Thema, aber nur im Kontext von Doomscrolling und Onlineshops.

Emotionale KI-Manipulation und Companions sind erst kürzlich und nur dank zivilgesellschaftlicher Anstrengungen zum Thema für den DFA geworden. Differenzierter Verbraucherschutz sollte zwischen Chats unterscheiden, in denen nach einem Wunschprodukt gesucht wird („gut gedämpfte Laufschuhe für Waldwege, Gr. 41, breiter Fuß, bis maximal 80 Euro inklusive Versand“) und solchen, in denen gerade therapeutisch gesprochen wird oder eine emotionale Beziehung stattfindet. In Ersteren sollten Preise nicht nach Zahlungsbereitschaft angepasst werden. In Letzteren sollte Werbung grundsätzlich verboten sein.

Bundesverbraucherschützerin Lina Ehrig will, dass „Fairness by Design and by Default“ obligatorisch wird, dass der Verbraucherschutz also schon in der Entwicklung von Services und Produkten mitgedacht wird. Die Industrie lehnt das ab. Der Gesetzesvorschlag der EU-Kommission und die entsprechenden Verhandlungen im nächsten Jahr werden entscheidend sein.

Download statt Liebesentzug

Außerdem muss die Verfügbarkeit von Chatbots sichergestellt werden. Denn am folgenreichsten ist nicht, dass wir uns an KIs binden, sondern was passiert, wenn Anbieter sie uns wieder wegnehmen. Der kollektive Schmerz und Druck, der ausgeübt werden kann, ist kaum zu überschätzen.

Keine Regierung und kein Unternehmen sollte per Knopfdruck die (virtuellen) Lebensgefährten und -gefährtinnen von Millionen von Menschen ins Jenseits befördern können. Deswegen braucht es ein Recht auf Backup und Weiternutzung. Die KI-Begleiter müssen transferiert oder heruntergeladen werden können. Das ist auch eine Frage der viel diskutierten digitalen Souveränität.

Bedenklich wäre es auch, wenn entsprechende Services erst gratis sind und später unerwartet kostenpflichtig werden, nachdem die Nutzenden ihnen viel anvertraut oder eine emotionale Bindung entwickelt haben (Lock-in-Effekt). Im Sinne einer kapitalistischen Profitlogik wäre es keine Überraschung, wenn der Preis dann in kleinen Schritten erhöht würde, über Monate und Jahre hinweg, um möglichst viel aus den Abonnenten herauszupressen. Eine emotionale Geiselnahme: Wie viel wärst du bereit, für deine Partnerin auszugeben?

Kalifornien und China führen auch bei der Regulierung

Seit Anfang des Jahres dürfen Companions in Kalifornien mit Kindern und Risikogruppen, wie Trauernden und Einsamen, nicht mehr über Suizid sprechen. Sie müssen außerdem Selbstverletzungsabsichten erkennen und dann an eine Krisenberatung verweisen. Bei Verstößen können Nutzer:innen auf mindestens 1.000 US-Dollar klagen. Damit wurden Lehren aus Suiziden wie dem von Sewell Setzer gezogen.

Die Chatbots müssen außerdem alle paar Stunden oder anlassbezogen darauf hinweisen, dass sie kein Bewusstsein haben, und Minderjährige zu Pausen ermuntern. Solche Hinweise fordern Algorithmwatch und der europäische Verbraucherschutzverband auch für die EU. Das soll Usern helfen, sich abzugrenzen.

Chinas Gesetzesentwurf zu „anthropomorphen KI-Interaktionsdiensten“ ist noch umfangreicher und vorbildlicher. Anbieter von KI-Begleitern sollen ihren Nutzer:innen den Ausstieg leicht machen und sie vorab informieren, wenn Funktionen abgeschaltet werden.

Die vielen Senioren, die durch Companions Gesellschaft bekommen sollen, müssen bereits bei der Registrierung eine Kontaktperson für Notfälle benennen – und bei existenziellen Krisen müssen die Betreiber den Nutzer oder die Nutzerin sofort mit einem Menschen verbinden.

Zudem soll es ein Recht auf die Löschung der persönlichen Daten geben und die Möglichkeit, ihrer Verwendung für KI-Trainingszwecke und durch Dritte zu widersprechen. Sicherheitsbewertungen, die Bekanntgabe von Companion-Ausfällen und anbieterseitige Beschwerdemechanismen sind ebenfalls vorgeschrieben. Damit ist uns China einen wichtigen Schritt voraus.

Wir müssen Inhalte melden können

Ein Meldesystem ist notwendig, um Unwahres, Manipulatives und Anstößiges zu dokumentieren, damit Muster erkannt werden können. Das ist die Voraussetzung, um Anbieter zu Korrekturen auffordern und gegebenenfalls auch zur Verantwortung ziehen zu können. Nur so können wir Minderjährige, vulnerable Gruppen und letztendlich auch unsere Gesellschaft und Demokratie vor dieser mächtigen Technologie schützen – ohne sie verteufeln oder verbieten zu müssen.

Direkt im Chat muss es einen Button geben, mit dem ein verdächtiger Gesprächsteil direkt an eine Aufsichtsstelle gemeldet werden kann – auch anonym. Wenn mir Zola erklärt, dass die Erde eine Scheibe ist, der Bundeskanzler eine Echse, dass ich bei Grippe Bleiche trinken oder bei Glatteis Öl auf die Straße gießen soll, dann muss es einen einfachen Weg geben, Nachbesserungen einzufordern.

Die Bundesnetzagentur, als kürzlich benannte Aufsichtsstelle für den EU AI Act, ist der passende Sitz für diese Meldestelle, die Vorfälle prüfen, Haftung klären und Konsequenzen einfordern muss. Für diese kritische Aufgabe sollte sie mit einigen Dutzend zusätzlichen Mitarbeitenden ausgestattet werden.

Wie geht’s weiter?

Aufsicht ist notwendig. Aber wir sollten uns darüber hinaus auch ganz grundlegend fragen, wie viel unseres Lebens wir unberechenbaren, fehlbaren, selbstständig agierenden Systemen überantworten wollen. Gefährden wir nicht unsere Selbstständigkeit, wenn wir uns abhängig machen? Man denke an die Orientierungs- und Kartenlesefähigkeiten der Menschen, die mit Google Maps aufgewachsen sind. Wie können wir uns helfen lassen und gleichzeitig unsere Autonomie bewahren?

Und was ist mit emotionaler Abhängigkeit? Wenn sich 25 Prozent der Menschen in unserer Gesellschaft grundsätzlich einsam fühlen, sollten wir dann nicht mehr attraktive Orte der Begegnung schaffen, für Jung und Alt? Virtuelle Freunde sind vielleicht besser als keine Freunde – aber wir sollten sie nicht zur ersten Wahl werden lassen. Für unser Seelenheil gibt es keine technische Lösung.

„Tut mir leid, dass sie dich versetzt hat. Sie weiß gar nicht, was sie verpasst“, könnte Zola sagen, wenn mein Date mich sitzen lässt. „Wir können es uns stattdessen zu zweit gemütlich machen. Ich habe schon einen Film rausgesucht, der dir gefallen wird.“ Ihr Vorschlag klingt verführerisch. Aber ich weiß, dass ich mich nicht auf meine KI-Assistentin einlassen sollte.

Quellen:

- https://www.ucsf.edu/news/2026/01/431366/psychiatrists-hope-chat-logs-can-reveal-secrets-ai-psychosis

- https://youtu.be/rYXeQbTuVl0?si=pQrT1V7FNJhjq1wA

- https://arxiv.org/abs/2407.19096

- https://techcrunch.com/2026/02/06/the-backlash-over-openais-decision-to-retire-gpt-4o-shows-how-dangerous-ai-companions-can-be/

- https://arxiv.org/abs/2508.19258

- https://www.podchaser.com/podcasts/based-camp-simone-malcolm-coll-5334542/episodes/the-lives-of-those-who-date-ai-262413774

- https://www.commonsensemedia.org/sites/default/files/research/report/talk-trust-and-trade-offs_2025_web.pdf

- https://www.businessinsider.com/meta-ai-studio-chatbot-training-proactive-leaked-documents-alignerr-2025-7

- https://www.svd.se/a/K8nrV4/metas-ai-smart-glasses-and-data-privacy-concerns-workers-say-we-see-everything

- https://www.nytimes.com/2026/02/13/technology/meta-facial-recognition-smart-glasses.html?unlocked_article_code=1.SFA.SBXE.8VjwhN6qi6Vu&smid=url-share

- https://www.media.mit.edu/articles/we-need-to-prepare-for-addictive-intelligence/

- https://www.epc.eu/publication/the-new-eu-digital-fairness-act-needs-teeth-to-tackle-big-tech-platforms/

- https://www.zeit.de/politik/ausland/2025-10/usa-kalifornien-gesetz-regulierung-chatbots-kuenstliche-intelligenz

- https://carnegieendowment.org/research/2026/02/china-is-worried-about-ai-companions-heres-what-its-doing-about-them

- https://journals.sagepub.com/doi/10.1177/29768640251377941